Publié en septembre 2025

Dernière modification : avril 2026

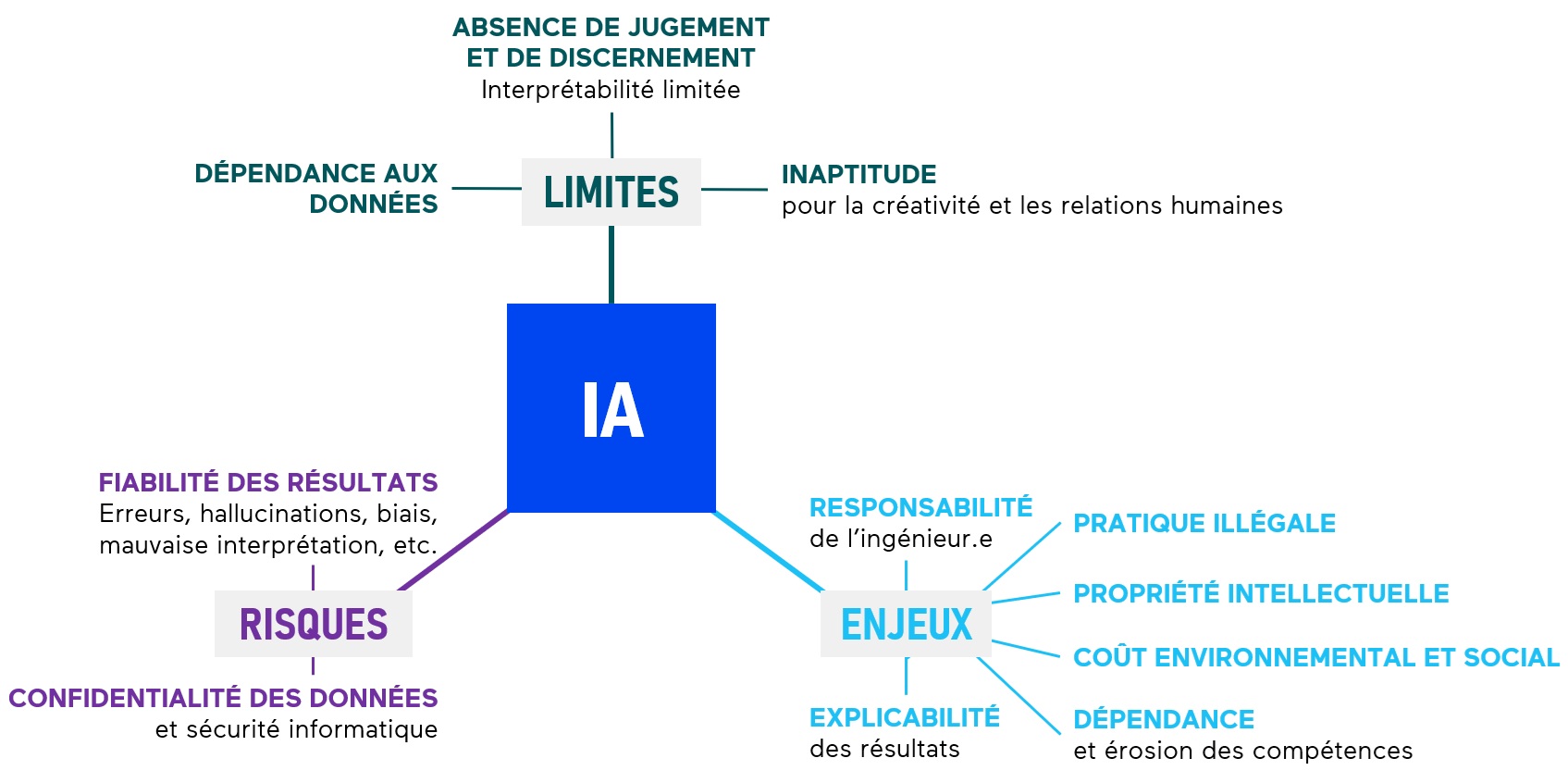

LIMITES, RISQUES ET ENJEUX DE L'IA EN INGÉNIERIE

L’utilisation de l’IA en ingénierie a ses limites et comporte un certain nombre de risques et d’enjeux dont il faut prendre conscience pour en faire une utilisation responsable. Face à ces risques, l’ingénieur.e doit maintenir un esprit critique et adopter de bonnes pratiques pour une utilisation de l’IA en pleine conscience.

Les limites, les risques et les enjeux de l'IA en ingénierie : ➜ Cliquez sur les éléments de l'image pour accéder rapidement aux contenus. LimitesAbsence de jugement et de discernementBien que se révélant un outil efficace et puissant, un SIA ne peut remplacer le jugement et l’esprit critique de l’ingénieur.e. En effet, un SIA ne peut faire preuve du discernement propre à l’ingénieur.e. Il lui est notamment impossible, par exemple, de prendre en compte l’ensemble des éléments contextuels d’un projet ou de remettre en question la qualité des données sur lesquelles il fonde ses décisions ou ses prédictions. Ce sont les connaissances et les aptitudes de l’ingénieur.e combinées à son expérience qui lui permettent d’appréhender la complexité et l’interdépendance des enjeux techniques, environnementaux, sociaux, éthiques et humains et de déterminer les actions requises. C’est pourquoi seul.e l’ingénieur.e est en mesure de prendre des décisions éclairées et d’assumer la responsabilité de son travail. Contrairement à l’ingénieur.e, capable de nuancer les informations disponibles et de repérer celles qui sont erronées, l’interprétabilité d’un SIA demeure limitée.

Dépendance aux donnéesPour fonctionner efficacement, un SIA nécessite généralement une grande quantité de données. La qualité et la performance du modèle dépendent directement des données utilisées lors de son entraînement. Ainsi, un modèle entraîné avec des données erronées, biaisées ou incomplètes risque de produire des résultats inexacts ou trompeurs, pouvant mener à de mauvaises décisions. Inaptitude pour la créativité et les relations humainesMême si l’IA peut aider l’ingénieur.e dans la génération d’idées ou l’exploration de solutions, la créativité humaine reste essentielle, notamment pour donner du sens, faire preuve d’intuition pour innover dans des contextes complexes. Aussi, si certaines interactions sociales peuvent être simulées par l’IA dans le cadre d’échanges simples, elle ne possède ni les compétences relationnelles ou émotionnelles ni la capacité d’adaptation contextuelle qui sont nécessaires pour gérer des relations humaines riches, telles que négocier avec un client, coordonner une équipe ou mobiliser des parties prenantes. RisquesFiabilité des résultats obtenus par IALes résultats produits par l’IA ne sont pas infaillibles et peuvent parfois être biaisés. Ils peuvent être trompeurs et contenir des erreurs. Cela représente un risque important et peut avoir de graves conséquences si l’ingénieur.e s’appuie sur ces résultats sans validation rigoureuse. Les erreurs générées par l’IA peuvent avoir différentes causes. En voici quelques-unes.

Mauvaise interprétation des résultatsSi les paramètres ou les hypothèses d’un modèle d’IA sont mal compris ou mal connus par l’ingénieur.e, les réponses générées par le modèle risquent d’être mal interprétées et peuvent mener à des erreurs dans les calculs ou dans les décisions subséquentes.

Confidentialité des données et sécurité informatiqueL’utilisation de l’IA comporte des risques importants en ce qui concerne la confidentialité des données et la sécurité informatique. En effet, qu’il s’agisse des données utilisées pour entraîner un modèle ou des données saisies dans le cadre de l’utilisation d’une technologie d’IA, les informations contenues dans ces données peuvent être mal protégées, interceptées et utilisées à des fins malveillantes. Cela peut être particulièrement néfaste lorsque les données contiennent des informations privées ou sensibles. Aussi, comme toute solution technologique, les SIA sont vulnérables aux cyberattaques. Des failles peuvent être exploitées de manière malintentionnée et entraîner, par exemple, une fuite ou un empoisonnement de données, une manipulation frauduleuse ou un dysfonctionnement plus ou moins critique de la solution. L’ingénieur.e doit donc rester extrêmement vigilant.e et adopter de bonnes pratiques pour garantir la confidentialité des données utilisées dans le cadre de solution d’IA et prévenir les risques de sécurité informatique. EnjeuxCompte tenu des risques énoncés plus haut, l’utilisation de l’IA comporte donc un certain nombre d’enjeux dont tout.e ingénieur.e devrait avoir conscience. Imputabilité de l’ingénieur.e qui utilise l‘IAL’IA n’a aucune personnalité sur le plan juridique et ne peut être tenue responsable des erreurs qu’elle commet. Mais alors, qui est responsable si l’erreur commise par l’IA cause un préjudice? La personne morale qui a conçu ou qui distribue le SIA? Ou la personne utilisatrice? Il n’est pas simple de répondre à cette question, mais, peu importe la situation, l’ingénieur.e demeure responsable de ses décisions, qu’elles soient prises ou non avec l’aide de l’IA. Pratique illégaleSi les SIA aident et facilitent le travail de l’ingénieur.e, ils permettent aussi de plus en plus facilement de se substituer à l’ingénieur.e. En ce sens, l’IA peut contribuer à l’émergence de pratiques illégales par des personnes à qui l’exercice de la profession n’est pas permis. ExplicabilitéIl n’est pas toujours possible de comprendre comment et pourquoi un SIA prend une décision ou produit un résultat. C’est particulièrement le cas lorsqu’il repose sur des modèles complexes, comme les réseaux de neurones profonds, perçus comme des boîtes noires. Pour l’ingénieur.e, il s’agit d’un enjeu majeur, car il ou elle doit être en mesure de valider que les réponses du SIA sont correctes, logiques et conformes aux exigences. Cela peut également poser un problème en cas d’audit ou de litige. Propriété intellectuelleUn modèle d’IA pourrait être entraîné sur des données protégées par le droit d’auteur (plans d’ingénierie, codes, images, etc.). L’utilisation d’un SIA dérivé de contenus protégés peut donc entraîner la violation de la propriété intellectuelle d’un tiers. Une autre question de propriété intellectuelle posée dans le cadre de l’utilisation de l’IA (pour, par exemple, générer une solution ou élaborer le design d’un objet) est de déterminer qui est le véritable auteur. Sur ce point, il est généralement reconnu que la contribution humaine doit être significative pour que la personne puisse se prévaloir du droit d’auteur. Par exemple, si l’ingénieur.e utilise un SIA comme outil d’aide à la conception, il ou elle reste l’auteur. À l’inverse, si l’IA génère un contenu de manière totalement autonome, aucun droit d’auteur ne peut être revendiqué. Coût environnemental et socialBien que l’IA puisse contribuer à des solutions écologiques (comme l’optimisation énergétique ou la surveillance environnementale), son développement et son utilisation soulèvent des défis importants en termes de durabilité, car les systèmes d’IA exigent une quantité énorme d’énergie et de ressources. Que ce soit pour l’entraînement des modèles ou lors de l’inférence (le processus d’exécution en temps réel des modèles d’IA), les serveurs d'IA nécessitent beaucoup plus d'électricité que les systèmes informatiques standards. Les centres de données nécessitent parfois de grandes quantités d’eau pour le refroidissement, exerçant parfois une certaine pression sur les ressources locales. De plus, l’expansion rapide de l’IA engendre une demande accrue en matériel spécialisé, mobilisant des ressources naturelles rares et générant de plus en plus de déchets électroniques. L’IA, souvent perçue comme automatique, repose toutefois sur une main-d’œuvre humaine : les travailleurs du numérique (data workers, en anglais). Ils sont généralement chargés de nettoyer et d’étiqueter les énormes quantités de données d’entraînement de certains modèles d’IA. Ce travail soulève des enjeux de justice sociale, car il est souvent réalisé dans des conditions très précaires, parfois dans les pays du Sud global, à des salaires très bas. Il peut être aussi psychologiquement très éprouvant lorsqu’il s’agit de modérer des contenus violents ou explicites. Enfin, dans de nombreux secteurs, l’IA peut constituer une certaine menace pour une frange de la main-d’œuvre qui, remplacée par des SIA, risque de perdre son emploi. Cela concerne nombre de professions, et les ingénieur.e.s, en particulier les plus jeunes, ne font pas exception. Dépendance à l’IA et érosion des compétencesL’utilisation croissante des SIA est susceptible d’entraîner une érosion des compétences cognitives. En effet, bien que conçus pour améliorer l'efficacité immédiate, les SIA peuvent aussi nuire à la performance humaine si, par exemple, on leur accorde une confiance aveugle ou s’ils deviennent indisponibles. En ingénierie où l’indépendance cognitive est cruciale, cela représente un risque. S’appuyer de manière excessive sur l’IA affecte son engagement mental et son sens critique, et affaiblit sa capacité à retenir l'information et à comprendre les processus complexes. Le recours excessif à l’IA peut également poser un problème pour les ingénieur.e.s moins expérimenté.e.s, car il restreint les occasions d'apprentissage, essentielles pour le développement des compétences avancées. Il est donc essentiel de ne pas développer une dépendance excessive à l’IA et de l’utiliser comme un outil d’assistance et non de substitution, de manière à rester impliqué dans les processus décisionnels et techniques. La confiance à l’IA doit être dans tous les cas prudente et réfléchie.

Ressources LIENS ET RÉFÉRENCES DE L'ORDRE

AUTRES LIENS ET RÉFÉRENCES

|

|